AI评估体系的核心悖论:从基准测试到真实部署的价值鸿沟

2019年深秋,我第一次在英国某医院放射科观察到AI评估的系统性问题。研究人员用99%的准确率标榜模型性能,临床医生却在实际工作中频繁手动修正输出。这种割裂成为我此后五年研究的核心起点。

测试环境与使用环境的根本错位

传统AI评估框架建立在一个隐含假设上:静态基准测试能够预测动态工作场景中的表现。从ImageNet到MMLU,从编程基准到法律考试,这个范式统治了行业数十年。

然而,当我把研究视野从实验室扩展到亚洲、欧洲、北美的医疗、人道主义、高等教育机构后,发现了一个令人不安的现象:基准分数与实际价值之间存在难以弥合的鸿沟。

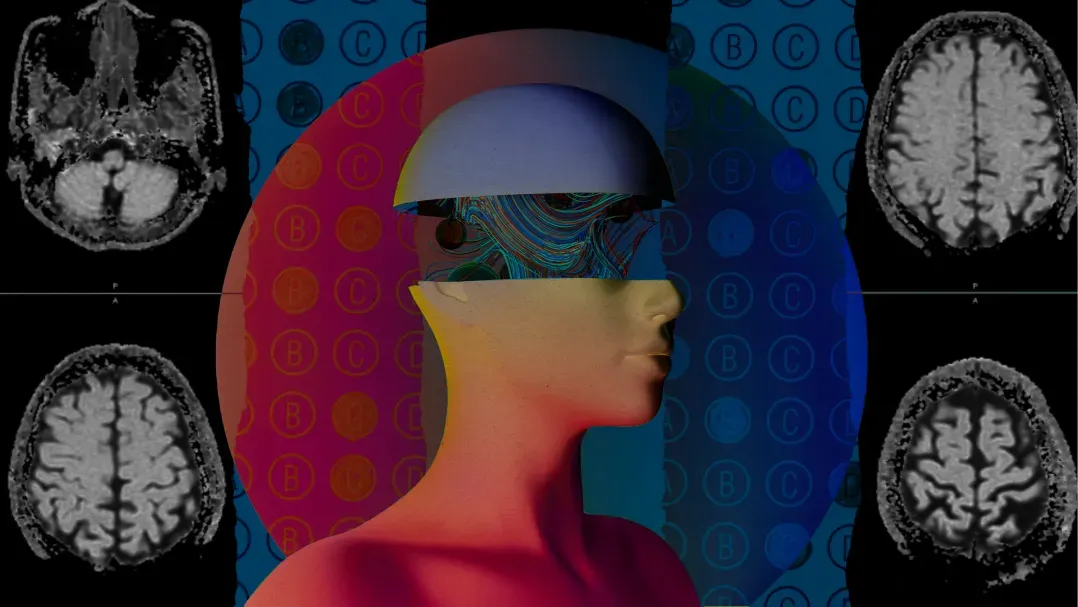

某款通过FDA审批的影像诊断AI,在标准测试中展现出超越放射科专家的准确率。但当我追踪其实际部署情况时,医护人员反馈的核心痛点并非准确率不足,而是AI输出与医院特定报告规范之间的适配成本。工具反而造成了额外的时间消耗。

四维度重构评估框架

基于对多个行业的深度调研,我提出HAIC评估体系,从四个维度重构传统基准测试。

第一,分析单元从单任务转向团队协作。2021至2024年间,英国某医院体系的实践验证了这一转向的必要性。他们将评估问题从“AI是否提升诊断准确率”扩展为“AI如何影响多学科团队的协作质量和集体推理”。这个转变揭示了单项指标无法捕捉的系统价值。

第二,时间维度从一次性测试转向长期影响评估。传统基准测试本质上是标准化考试,而真正的职业能力评估依赖持续反馈循环。我在人道主义领域追踪了一个AI系统18个月的部署轨迹,重点分析错误可发现性——人类能否及时识别和纠正AI错误。这个纵向视角发现了短期测试永远无法触及的系统性风险。

第三,性能指标从正确性速度转向组织成效和协作质量。这意味着评估重心从技术参数转向AI是否真正增强了团队的问题解决能力。

第四,系统视角从孤立输出转向上下游连锁效应。某款AI可能在单一诊断环节超越医生,却可能引入系统性扭曲:过早锚定、认知负担增加、下游效率损失。这些连锁效应恰恰是传统基准测试的盲区。

方法论落地的实践路径

HAIC体系的实施确实增加了评估的复杂度和资源消耗。但如果我们继续在脱离真实工作环境的无菌条件下评估AI,就会持续误判其真实能力边界。

对于组织决策者而言,关键启示在于:采购AI系统时,必须追问该系统在真实工作流程中的纵向表现,而非仅仅依赖供应商提供的基准分数。对于监管机构,HAIC框架意味着需要建立反映实际使用场景的评估标准,而非被片面的技术指标所误导。

AI的真正价值不在于真空中的卓越表现,而在于它能否作为人类团队的有效参与者,创造持续的、集体性的价值。这是评估范式转移的核心命题。